Automatizar a ingestão e o processamento de dados usando o Azure Databricks

O Databricks Jobs é um serviço avançado para automação de fluxos de trabalho de ingestão e processamento de dados. Com ele, é possível orquestrar pipelines de dados complexos, que podem incluir tarefas como ingerir dados brutos de várias fontes, transformando esses dados usando Delta Live Tables e mantendo-os no Delta Lake para análise posterior. Com o Azure Databricks, os usuários podem agendar e executar tarefas de processamento de dados automaticamente, garantindo que os dados estejam sempre atualizados e disponíveis para processos de tomada de decisão.

Este laboratório levará aproximadamente 20 minutos para ser concluído.

Observação: a interface do usuário do Azure Databricks está sujeita a melhorias contínuas. A interface do usuário pode ter sido alterada desde que as instruções neste exercício foram escritas.

Provisionar um workspace do Azure Databricks

Dica: Se você já tem um workspace do Azure Databricks, pode ignorar esse procedimento e usar o workspace existente.

Este exercício inclui um script para provisionar um novo workspace do Azure Databricks. O script tenta criar um recurso de workspace do Azure Databricks de camada Premium em uma região na qual sua assinatura do Azure tenha cota suficiente para os núcleos de computação necessários para este exercício; e pressupõe que sua conta de usuário tenha permissões suficientes na assinatura para criar um recurso de workspace do Azure Databricks. Se o script falhar devido a cota ou permissões insuficientes, você pode tentar criar um workspace do Azure Databricks interativamente no portal do Azure.

- Em um navegador da web, faça logon no portal do Azure em

https://portal.azure.com. -

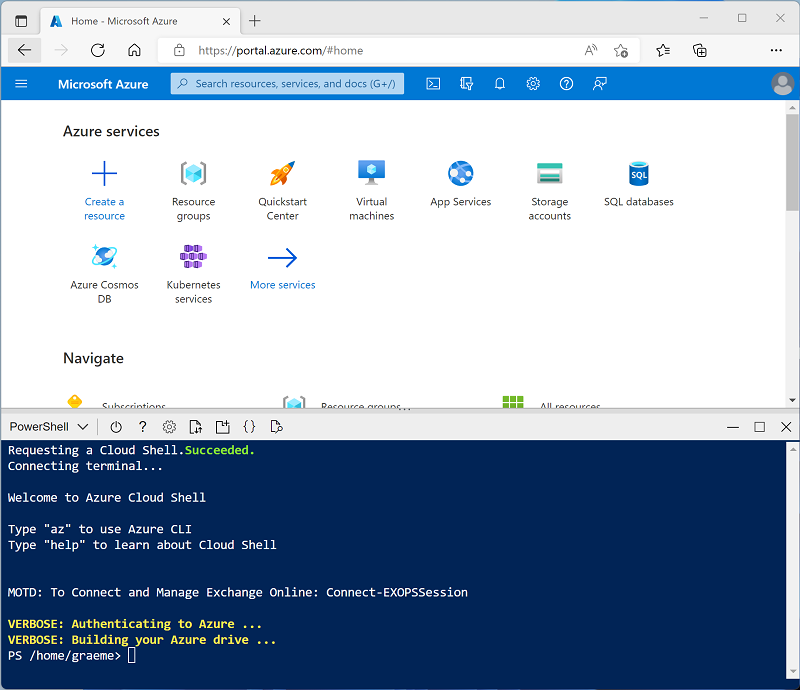

Use o botão [>_] à direita da barra de pesquisa na parte superior da página para criar um Cloud Shell no portal do Azure selecionando um ambiente do PowerShell. O Cloud Shell fornece uma interface de linha de comando em um painel na parte inferior do portal do Azure, conforme mostrado aqui:

Observação: se você já criou um Cloud Shell que usa um ambiente Bash, alterne-o para o PowerShell.

-

Você pode redimensionar o Cloud Shell arrastando a barra de separação na parte superior do painel ou usando os ícones —, ⤢ e X no canto superior direito do painel para minimizar, maximizar e fechar o painel. Para obter mais informações de como usar o Azure Cloud Shell, confira a documentação do Azure Cloud Shell.

-

No painel do PowerShell, insira os seguintes comandos para clonar esse repositório:

rm -r mslearn-databricks -f git clone https://github.com/MicrosoftLearning/mslearn-databricks -

Depois que o repositório tiver sido clonado, insira o seguinte comando para executar setup.ps1 do script, que provisiona um workspace do Azure Databricks em uma região disponível:

./mslearn-databricks/setup.ps1 -

Se solicitado, escolha qual assinatura você deseja usar (isso só acontecerá se você tiver acesso a várias assinaturas do Azure).

- Aguarde a conclusão do script – isso normalmente leva cerca de 5 minutos, mas em alguns casos pode levar mais tempo. Enquanto você aguarda, revise o artigo Agendar e orquestrar fluxos de trabalho na documentação do Azure Databricks.

Criar um cluster

O Azure Databricks é uma plataforma de processamento distribuído que usa clusters do Apache Spark para processar dados em paralelo em vários nós. Cada cluster consiste em um nó de driver para coordenar o trabalho e nós de trabalho para executar tarefas de processamento. Neste exercício, você criará um cluster de nó único para minimizar os recursos de computação usados no ambiente de laboratório (no qual os recursos podem ser restritos). Em um ambiente de produção, você normalmente criaria um cluster com vários nós de trabalho.

Dica: Se você já tiver um cluster com uma versão 13.3 LTS de runtime ou superior em seu workspace do Azure Databricks, poderá usá-lo para concluir este exercício e ignorar este procedimento.

-

No portal do Azure, navegue até o grupo de recursos msl-xxxxxxx criado pelo script (ou o grupo de recursos que contém seu workspace do Azure Databricks)

-

Selecione o recurso Serviço do Azure Databricks (chamado databricks-xxxxxxx se você usou o script de instalação para criá-lo).

-

Na página Visão geral do seu workspace, use o botão Iniciar workspace para abrir seu workspace do Azure Databricks em uma nova guia do navegador, fazendo o logon se solicitado.

Dica: ao usar o portal do workspace do Databricks, várias dicas e notificações podem ser exibidas. Dispense-as e siga as instruções fornecidas para concluir as tarefas neste exercício.

-

Na barra lateral à esquerda, selecione a tarefa (+) Novo e, em seguida, selecione Cluster (talvez você precise procurar no submenu Mais).

- Na página Novo cluster, crie um novo cluster com as seguintes configurações:

- Nome do cluster: cluster Nome do Usuário (o nome do cluster padrão)

- Política: Sem restrições

- Modo de cluster: Nó Único

- Modo de acesso: Usuário único (com sua conta de usuário selecionada)

- Versão do runtime do Databricks: 13.3 LTS (Spark 3.4.1, Scala 2.12) ou posterior

- Usar Aceleração do Photon: Selecionado

- Tipo de nó: Standard_D4ds_v5

- Encerra após 20 minutos de inatividade

-

Aguarde a criação do cluster. Isso pode levar alguns minutos.

Observação: se o cluster não for iniciado, sua assinatura pode ter cota insuficiente na região onde seu workspace do Azure Databricks está provisionado. Consulte Limite de núcleo da CPU impede a criação do cluster para obter detalhes. Se isso acontecer, você pode tentar excluir seu workspace e criar um novo workspace em uma região diferente. Você pode especificar uma região como um parâmetro para o script de instalação da seguinte maneira:

./mslearn-databricks/setup.ps1 eastus

Criar um notebook e obter dados de origem

-

Na barra lateral, use o link (+) Novo para criar um Notebook e altere o nome do notebook padrão (Notebook sem título [data]) para Processamento de dados. Em seguida, na lista suspensa Conectar, selecione o cluster caso ainda não esteja selecionado. Se o cluster não executar, é porque ele pode levar cerca de um minuto para iniciar.

-

Na primeira célula do notebook, insira o código a seguir, que usa os comandos de shell para baixar os arquivos de dados do GitHub para o sistema de arquivos usado pelo cluster.

%sh rm -r /dbfs/FileStore mkdir /dbfs/FileStore wget -O /dbfs/FileStore/sample_sales_data.csv https://github.com/MicrosoftLearning/mslearn-databricks/raw/main/data/sample_sales_data.csv -

Use a opção de menu ▸ Executar Célula à esquerda da célula para executá-la. Em seguida, aguarde o término do trabalho do Spark executado pelo código.

Automatização do processamento de dados com o Azure Databricks Jobs

-

Substitua o código no primeiro notebook pelo código a seguir. Em seguida, execute-o para carregar os dados em um DataFrame:

# Load the sample dataset into a DataFrame df = spark.read.csv('/FileStore/*.csv', header=True, inferSchema=True) df.show() -

Passe o mouse sob a célula de código existente e use o ícone + Código exibido para adicionar uma nova célula de código. Em seguida, na nova célula, insira e execute o seguinte código para agregar dados de vendas por categoria de produto:

from pyspark.sql.functions import col, sum # Aggregate sales data by product category sales_by_category = df.groupBy('product_category').agg(sum('transaction_amount').alias('total_sales')) sales_by_category.show() -

Na barra lateral, use o link (+) Novo para criar um Trabalho.

-

Altere o nome do trabalho padrão (Novo trabalho [data]) para

Automated job. - Configure a tarefa sem nome no trabalho com as seguintes configurações:

- Nome da tarefa::

Run notebook - Tipo: Notebook

- Fonte: Workspace

- Caminho: selecione seu notebook Processamento de Dados

- Cluster: Selecione seu cluster

- Nome da tarefa::

-

Selecione Criar tarefa.

-

Selecione Executar agora

Dica: no painel do lado direito, em Agendamento, você pode selecionar Adicionar gatilho e configurar uma programação para executar o trabalho (por exemplo, diariamente, semanalmente). No entanto, para este exercício, vamos executá-lo manualmente.

-

Selecione a guia Execuções no painel Trabalho e monitore a execução do trabalho.

-

Após a execução bem-sucedida do trabalho, você pode selecioná-lo na lista Execuções e verificar sua saída.

Você configurou e automatizou com êxito a ingestão e o processamento de dados usando os trabalhos do Azure Databricks. Agora você pode dimensionar essa solução para lidar com pipelines de dados mais complexos e integrar a outros serviços do Azure para ter uma arquitetura robusta de processamento de dados.

Limpar

No portal do Azure Databricks, na página Computação, selecione seu cluster e selecione ■ Terminar para encerrar o processo.

Se você tiver terminado de explorar o Azure Databricks, poderá excluir os recursos que criou para evitar custos desnecessários do Azure e liberar capacidade em sua assinatura.