Erstellen Ihrer ersten Pipeline mit Delta Live Tables

Delta Live Tables ist ein deklaratives Framework für die Erstellung zuverlässiger, verwaltbarer und testbarer Datenverarbeitungspipelines. Eine Pipeline ist die Haupteinheit, die zur Konfiguration und Ausführung von Datenverarbeitungs-Workflows mit Delta Live Tables verwendet wird. Sie verknüpft Datenquellen mit Zieldatensätzen über einen in Python oder SQL deklarierten gerichtenen azyklischen Graphen (DAG).

Dieses Lab dauert ungefähr 40 Minuten.

Hinweis: Die Benutzeroberfläche von Azure Databricks wird kontinuierlich verbessert. Die Benutzeroberfläche kann sich seit der Erstellung der Anweisungen in dieser Übung geändert haben.

Bereitstellen eines Azure Databricks-Arbeitsbereichs

Tipp: Wenn Sie bereits über einen Azure Databricks-Arbeitsbereich verfügen, können Sie dieses Verfahren überspringen und Ihren vorhandenen Arbeitsbereich verwenden.

Diese Übung enthält ein Skript zum Bereitstellen eines neuen Azure Databricks-Arbeitsbereichs. Das Skript versucht, eine Azure Databricks-Arbeitsbereichsressource im Premium-Tarif in einer Region zu erstellen, in der Ihr Azure-Abonnement über ein ausreichendes Kontingent für die in dieser Übung erforderlichen Computekerne verfügt. Es wird davon ausgegangen, dass Ihr Benutzerkonto über ausreichende Berechtigungen im Abonnement verfügt, um eine Azure Databricks-Arbeitsbereichsressource zu erstellen. Wenn das Skript aufgrund unzureichender Kontingente oder Berechtigungen fehlschlägt, können Sie versuchen, einen Azure Databricks-Arbeitsbereich interaktiv im Azure-Portal zu erstellen.

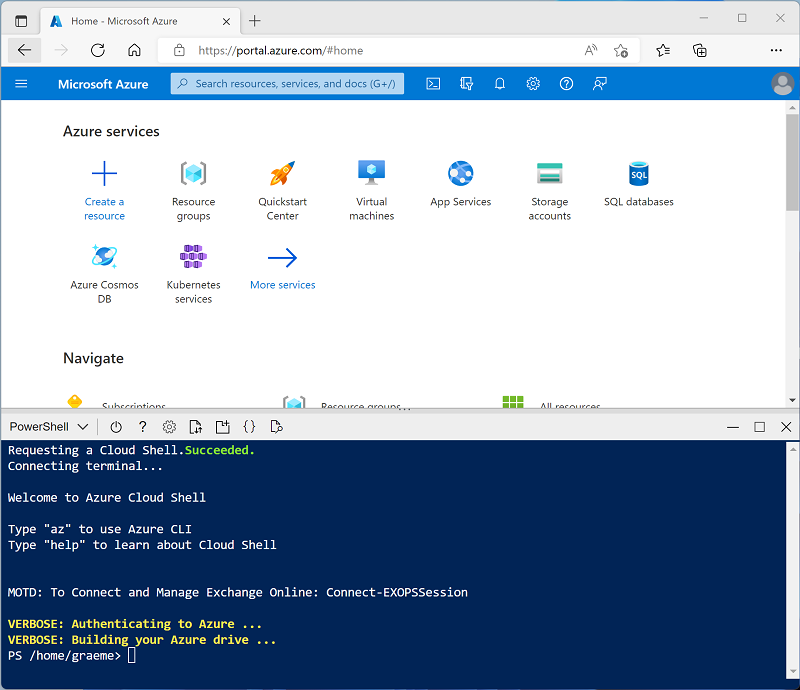

- Melden Sie sich in einem Webbrowser am Azure-Portal unter

https://portal.azure.coman. -

Verwenden Sie die Taste [>_] rechts neben der Suchleiste oben auf der Seite, um eine neue Cloud Shell im Azure-Portal zu erstellen, und wählen Sie eine PowerShell-Umgebung aus. Die Cloud Shell bietet eine Befehlszeilenschnittstelle in einem Bereich am unteren Rand des Azure-Portals, wie hier gezeigt:

Hinweis: Wenn Sie zuvor eine Cloud-Shell erstellt haben, die eine Bash-Umgebung verwendet, wechseln Sie zu PowerShell.

-

Beachten Sie, dass Sie die Größe der Cloud-Shell ändern können, indem Sie die Trennlinie oben im Bereich ziehen oder die Symbole —, ⤢ und X oben rechts im Bereich verwenden, um den Bereich zu minimieren, zu maximieren und zu schließen. Weitere Informationen zur Verwendung von Azure Cloud Shell finden Sie in der Azure Cloud Shell-Dokumentation.

-

Geben Sie im PowerShell-Bereich die folgenden Befehle ein, um dieses Repository zu klonen:

rm -r mslearn-databricks -f git clone https://github.com/MicrosoftLearning/mslearn-databricks -

Nachdem das Repository geklont wurde, geben Sie den folgenden Befehl ein, um das Skript setup.ps1 auszuführen, das einen Azure Databricks-Arbeitsbereich in einer verfügbaren Region bereitstellt:

./mslearn-databricks/setup.ps1 -

Wenn Sie dazu aufgefordert werden, wählen Sie aus, welches Abonnement Sie verwenden möchten (dies geschieht nur, wenn Sie Zugriff auf mehrere Azure-Abonnements haben).

- Warten Sie, bis das Skript abgeschlossen ist. Dies dauert in der Regel etwa 5 Minuten, in einigen Fällen kann es jedoch länger dauern. Während Sie warten, lesen Sie den Artikel Was sind Delta-Live-Tabellen? in der Azure-Databricks-Dokumentation.

Erstellen eines Clusters

Azure Databricks ist eine verteilte Verarbeitungsplattform, die Apache Spark-Cluster verwendet, um Daten parallel auf mehreren Knoten zu verarbeiten. Jeder Cluster besteht aus einem Treiberknoten, um die Arbeit zu koordinieren, und Arbeitsknoten zum Ausführen von Verarbeitungsaufgaben. In dieser Übung erstellen Sie einen Einzelknotencluster , um die in der Lab-Umgebung verwendeten Computeressourcen zu minimieren (in denen Ressourcen möglicherweise eingeschränkt werden). In einer Produktionsumgebung erstellen Sie in der Regel einen Cluster mit mehreren Workerknoten.

Tipp: Wenn Sie bereits über einen Cluster mit einer Runtime 13.3 LTS oder einer höheren Runtimeversion in Ihrem Azure Databricks-Arbeitsbereich verfügen, können Sie ihn verwenden, um diese Übung abzuschließen und dieses Verfahren zu überspringen.

-

Navigieren Sie im Azure-Portal zur Ressourcengruppe msl-xxxxxxx, die vom Skript erstellt wurde (oder zur Ressourcengruppe, die Ihren vorhandenen Azure Databricks-Arbeitsbereich enthält).

-

Wählen Sie die Ressource Ihres Azure Databricks-Diensts aus (sie trägt den Namen databricks-xxxxxxx, wenn Sie das Setupskript zum Erstellen verwendet haben).

-

Verwenden Sie auf der Seite Übersicht für Ihren Arbeitsbereich die Schaltfläche Arbeitsbereich starten, um Ihren Azure Databricks-Arbeitsbereich auf einer neuen Browserregisterkarte zu öffnen. Melden Sie sich an, wenn Sie dazu aufgefordert werden.

Tipp: Während Sie das Databricks-Arbeitsbereichsportal verwenden, werden möglicherweise verschiedene Tipps und Benachrichtigungen angezeigt. Schließen Sie diese, und folgen Sie den Anweisungen, um die Aufgaben in dieser Übung auszuführen.

-

Wählen Sie in der linken Seitenleiste die Option (+) Neue Aufgabe und dann Cluster aus (ggf. im Untermenü Mehr suchen).

- Erstellen Sie auf der Seite Neuer Cluster einen neuen Cluster mit den folgenden Einstellungen:

- Clustername: Cluster des Benutzernamens (der Standardclustername)

- Richtlinie: Unrestricted

- Clustermodus: Einzelknoten

- Zugriffsmodus: Einzelner Benutzer (Ihr Benutzerkonto ist ausgewählt)

- Databricks-Runtimeversion: 13.3 LTS (Spark 3.4.1, Scala 2.12) oder höher

- Photonbeschleunigung verwenden: Ausgewählt

- Knotentyp: Standard_D4ds_v5

- Beenden nach 20 Minuten Inaktivität

-

Warten Sie, bis der Cluster erstellt wurde. Es kann ein oder zwei Minuten dauern.

Hinweis: Wenn Ihr Cluster nicht gestartet werden kann, verfügt Ihr Abonnement möglicherweise über ein unzureichendes Kontingent in der Region, in der Ihr Azure Databricks-Arbeitsbereich bereitgestellt wird. Details finden Sie unter Der Grenzwert für CPU-Kerne verhindert die Clustererstellung. In diesem Fall können Sie versuchen, Ihren Arbeitsbereich zu löschen und in einer anderen Region einen neuen zu erstellen. Sie können einen Bereich als Parameter für das Setupskript wie folgt angeben:

./mslearn-databricks/setup.ps1 eastus

Erstellen eines Notebook und Erfassen von Daten

-

Verwenden Sie in der Randleiste den Link ** (+) Neu, um ein **Notebook zu erstellen.

-

Ändern Sie den Standardnamen des Notebooks (Unbenanntes Notebook [Datum]) in

Create a pipeline with Delta Live tablesund wählen Sie in der Dropdown-Liste Verbinden Ihren Cluster aus, falls er nicht bereits ausgewählt ist. Wenn der Cluster nicht ausgeführt wird, kann es eine Minute dauern, bis er gestartet wird. -

Geben Sie in der ersten Zelle des Notebooks den folgenden Code ein, der mit Shellbefehlen die Datendateien von GitHub in das von Ihrem Cluster verwendete Dateisystem herunterlädt.

%sh rm -r /dbfs/delta_lab mkdir /dbfs/delta_lab wget -O /dbfs/delta_lab/covid_data.csv https://github.com/MicrosoftLearning/mslearn-databricks/raw/main/data/covid_data.csv -

Verwenden Sie Menüoption ▸ Zelle Ausführen links neben der Zelle, um sie auszuführen. Warten Sie dann, bis der vom Code ausgeführte Spark-Auftrag, abgeschlossen ist.

Erstellen einer Delta Live Tables-Pipeline mit SQL

-

Erstellen Sie ein neues Notebook und benennen Sie es in

Pipeline Notebookum. -

Wählen Sie neben dem Namen des Notebooks die Option Python aus und ändern Sie die Standardsprache in SQL.

-

Geben Sie den folgenden Code in die erste Zelle ein, ohne ihn auszuführen. Alle Zellen werden ausgeführt, nachdem die Pipeline erstellt wurde. Dieser Code definiert eine Delta Live Table, die mit den zuvor heruntergeladenen Rohdaten ausgefüllt wird:

CREATE OR REFRESH LIVE TABLE raw_covid_data COMMENT "COVID sample dataset. This data was ingested from the COVID-19 Data Repository by the Center for Systems Science and Engineering (CSSE) at Johns Hopkins University." AS SELECT Last_Update, Country_Region, Confirmed, Deaths, Recovered FROM read_files('dbfs:/delta_lab/covid_data.csv', format => 'csv', header => true) -

Verwenden Sie unter der ersten Zelle das Symbol + Code, um eine neue Zelle hinzuzufügen, und drücken Sie die Eingabetaste, um die Daten aus der vorherigen Tabelle vor der Analyse abzufragen, zu filtern und zu formatieren.

CREATE OR REFRESH LIVE TABLE processed_covid_data( CONSTRAINT valid_country_region EXPECT (Country_Region IS NOT NULL) ON VIOLATION FAIL UPDATE ) COMMENT "Formatted and filtered data for analysis." AS SELECT TO_DATE(Last_Update, 'MM/dd/yyyy') as Report_Date, Country_Region, Confirmed, Deaths, Recovered FROM live.raw_covid_data; -

Geben Sie in eine dritte neue Codezelle den folgenden Code ein, der eine angereicherte Datenansicht für die weitere Analyse erstellt, sobald die Pipeline erfolgreich ausgeführt wurde.

CREATE OR REFRESH LIVE TABLE aggregated_covid_data COMMENT "Aggregated daily data for the US with total counts." AS SELECT Report_Date, sum(Confirmed) as Total_Confirmed, sum(Deaths) as Total_Deaths, sum(Recovered) as Total_Recovered FROM live.processed_covid_data GROUP BY Report_Date; -

Wählen Sie Delta Live Tables in der linken Randleiste und dann Pipeline erstellen aus.

- Erstellen Sie auf der Seite Pipeline erstellen eine neue Pipeline mit den folgenden Einstellungen:

- Pipeline Name:

Covid Pipeline - Produktedition: Erweitert

- Pipelinemodus: Ausgelöst

- Quellcode: Navigieren Sie zu Ihrem Pipeline-Notebook imUsers/user@nameOrdner.

- Speicheroptionen: Hive-Metastore

- Speicherort:

dbfs:/pipelines/delta_lab - Zielschema: Eingabetaste

default

- Pipeline Name:

-

Wählen Sie Erstellen und anschließend Start aus. Warten Sie dann, bis die Pipeline ausgeführt wird (was einige Zeit dauern kann).

-

Nachdem die Pipeline erfolgreich ausgeführt wurde, navigieren Sie zurück zum NotebookErstellen einer Pipeline mit Delta Live-Tabellen, das Sie zuerst erstellt haben, und führen Sie den folgenden Code in einer neuen Zelle aus, um zu überprüfen, ob die Dateien für alle drei neuen Tabellen am angegebenen Speicherort erstellt wurden:

display(dbutils.fs.ls("dbfs:/pipelines/delta_lab/tables")) -

Fügen Sie eine weitere Codezelle hinzu, und führen Sie den folgenden Code aus, um zu überprüfen, ob die Tabellen in der Standard-Datenbank erstellt wurden:

%sql SHOW TABLES

Anzeigen von Ergebnissen als Visualisierung

Nach dem Erstellen der Tabellen ist es möglich, sie in Datenframes zu laden und die Daten zu visualisieren.

-

Fügen Sie im Notebook Erstellen einer Pipeline mit Delta-Live-Tabellen eine neue Codezelle hinzu und führen Sie den folgenden Code aus, um

aggregated_covid_datain einen DataFrame zu laden:%sql SELECT * FROM aggregated_covid_data - Wählen Sie oberhalb der Ergebnistabelle + und dann Visualisierung aus, um den Visualisierungs-Editor anzuzeigen, und wenden Sie dann die folgenden Optionen an:

- Visualisierungstyp: Linie

- X-Spalte: Report_Date

- Y-Spalte: Fügen Sie eine neue Spalte hinzu und wählen SieTotal_Confirmed aus. Wenden Sie die Aggregation Summe aus.

- Speichern Sie die Visualisierung, und zeigen Sie das resultierende Diagramm im Notebook an.

Bereinigen

Wählen Sie zunächst im Azure Databricks-Portal auf der Seite Compute Ihren Cluster und dann ■ Beenden aus, um ihn herunterzufahren.

Wenn Sie die Erkundung von Azure Databricks abgeschlossen haben, löschen Sie die erstellten Ressourcen, um unnötige Azure-Kosten zu vermeiden und Kapazität in Ihrem Abonnement freizugeben.