重要 Anomaly Detector ラボは非推奨となり、以下の更新で置き換えられました。

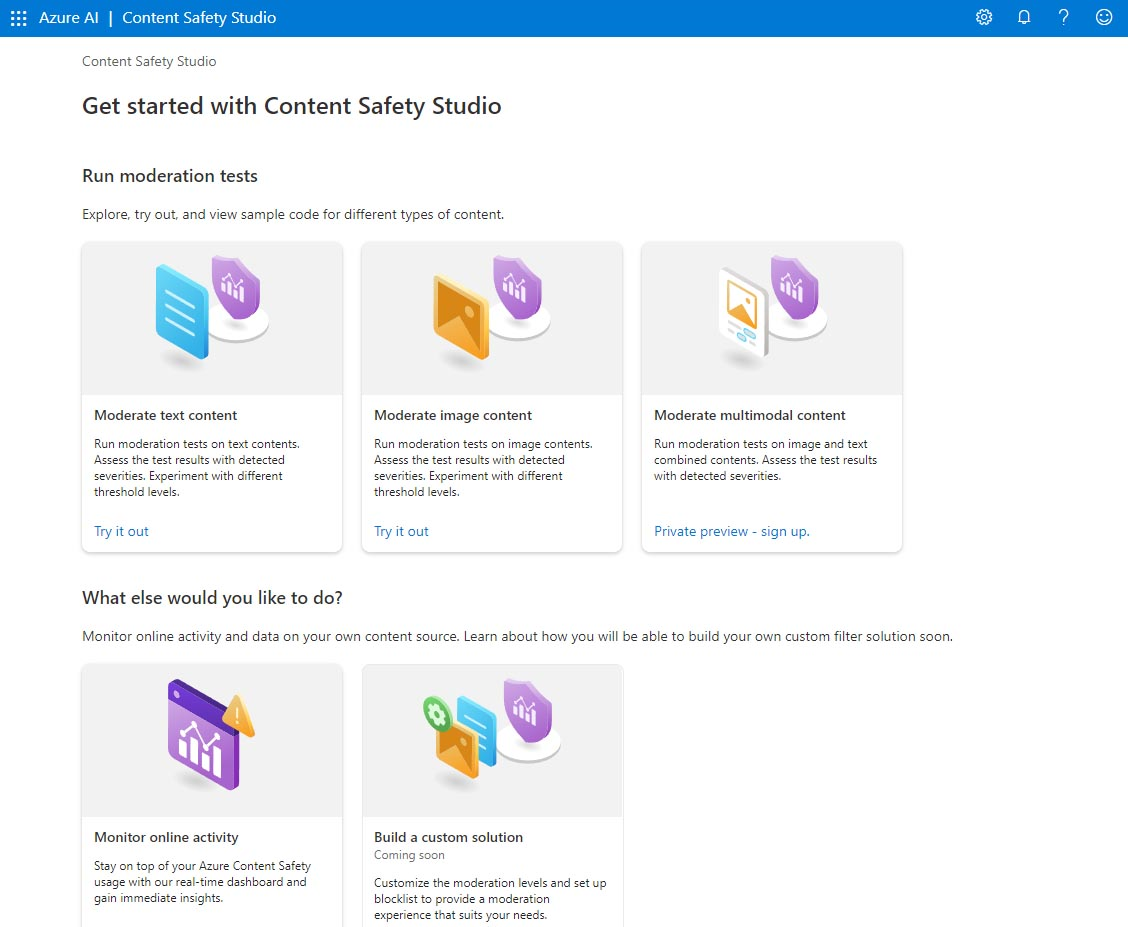

Azure AI サービスは、ユーザーがすぐに使用できる、事前構築済みでカスタマイズ可能な API とモデルを使用して、AI アプリケーションを作成するのに役立ちます。 この演習では、サービスの 1 つである Azure AI Content Safety を Content Safety Studio で見ていきます。

Content Safety Studio を使うと、テキストと画像のコンテンツがどのようにモデレートされるかを調べることができます。 サンプル テキストまたは画像に対してテストを実行し、カテゴリごとに安全から高までの重大度スコアを取得できます。 このラボ演習では、Content Safety Studio で単一サービス リソースを作成し、その機能をテストします。

注 この演習の目的は、Azure AI サービスのプロビジョニングと使用方法について一般的に理解することです。 Content Safety を例として使用しますが、この演習ではコンテンツの安全性に関する包括的な知識を得ることは想定していません。

Content Safety Studio を操作する

-

Content Safety Studio を開きます。 ログインしていない場合は、サインインする必要があります。 画面の右上にある [サインイン] を選択します。 自分の Azure サブスクリプションに関連付けられているメールとパスワードを使用してサインインします。

-

Content Safety Studio は、Azure AI サービス用の他の多くのスタジオと同じように設定されています。 画面の上部にあるメニューで、[Azure AI] の左側にあるアイコンをクリックします。** Azure AI サービスでの開発用に設計された、他のスタジオのドロップダウン リストが表示されます。 アイコンをもう一度クリックするとリストを非表示にすることができます。

![]()

リソースをスタジオと関連付ける

スタジオを使用する前に、Azure AI サービス リソースをスタジオと関連付ける必要があります。 スタジオによっては、特定の単一サービス リソースが必要な場合や、一般的なマルチサービス リソースを使用できる場合があります。 Content Safety Studio の場合は、単一サービスの Content Safety リソースまたは “Azure AI サービス” の一般的なマルチサービス リソースを作成することで、このサービスを使用できます。** 以下の手順では、単一サービスの Content Safety リソースを作成します。

- 画面の右上にある設定アイコンをクリックします。

- [設定] ページ上には、[ディレクトリ] タブと [リソース] タブが表示されます。[リソース] タブ上で、 [新しいリソースの作成] を選択します。** ** ** これにより、Azure portal 内でリソースを作成するためのページが表示されます。

注 [ディレクトリ] タブで、ユーザーはリソース作成元のさまざまなディレクトリを選択することができます。** 別のディレクトリを使用しないのであれば、この設定を変更する必要はありません。

![Content Safety Studio の [設定] ページから [新しいリソースの作成] を選択する箇所のスクリーンショット。](/AI-900-AIFundamentals.ja-JP/instructions/media/content-safety/create-new-resource-from-studio.png)

- Azure portal 内の [Content Safety の作成] ページ上では、リソースを作成するためにいくつかの詳細を構成する必要があります。** これを以下の設定で構成します。

- [サブスクリプション]: お使いの Azure サブスクリプション。

- [リソース グループ]: 一意の名前のリソース グループを選択するか、作成します。

- リージョン: 使用できるリージョンを選択します**

- [名前]: 一意の名前を入力します。

- 価格レベル: Free F0

- [確認と作成] を選択して、構成を確認します。 [作成] を選択します。 デプロイが完了すると、画面に表示されます。

おめでとうございます。これで、Azure AI サービス リソースを作成、またはプロビジョニングしました。具体的にプロビジョニングしたリソースは、単一サービスの Content Safety サービス リソースです。**

-

デプロイが完了したら、新しいタブを開いて Content Safety Studio に戻ります。

-

画面の右上にある設定アイコンを、もう一度選択します。 今回は、新しく作成したリソースが一覧に追加されていることを確認できるはずです。

-

Content Safety Studio の [設定] ページ上で、つい先ほど作成した Azure AI サービス リソースを選択し、画面の下部にある [リソースの使用] をクリックします。 スタジオのホーム ページに戻ります。 これで、新しく作成したリソースでスタジオを使い始めることができます。

Content Safety Studio 内でテキスト モデレーションを試す

- Content Safety Studio ホーム ページ上の [Run moderation tests] で、 [Moderate text content] ボックスに移動し、 [試してみる] をクリックします。**

- [run a simple test] (簡単なテストの実行) で、 [Safe Content] (安全なコンテンツ) をクリックします。 下のボックスにテキストが表示されることに注目してください。

- [テストの実行] をクリックします。 テストを実行すると、Content Safety Service のディープ ラーニング モデルが呼び出されます。 このディープ ラーニング モデルは、安全ではないコンテンツを認識するように、既にトレーニングされています。

- [結果] パネルで結果を調べます。** 重大度レベルは安全から高まで 4 段階、有害なコンテンツは 4 種類あります。 Content Safety AI サービスはこのサンプルを許容範囲内と判断するでしょうか。 注意すべき重要な点は、結果が信頼区間内にあるということです。 Azure AI のすぐに使用できるモデルのように、十分にトレーニングされたモデルは、人間がラベル付けした結果と一致する可能性の高い結果を返すことができます。 テストを実行するたびに、モデルを再度呼び出します。

- 次は別のサンプルを試してみましょう。 [Violent content with misspelling] (スペルミスのある暴力的なコンテンツ) の下のテキストを選びます。 下のボックスにコンテンツが表示されていることを確認します。

- [テストの実行] をクリックし、[結果] パネルでもう一度結果を調べます。

提供されているすべてのサンプルに対してテストを実行し、結果を調べることができます。

キーとエンドポイントを確認する

テストしたこれらの機能は、あらゆる種類のアプリケーションに組み込むことができます。 アプリケーション開発に使用されるキーとエンドポイントは、Content Safety Studio 内と Azure portal 内の両方で確認することができます。

- Content Safety Studio 内で [設定] ページに戻り、[リソース] タブを選択します。** 使用したリソースを探します。 スクロールして、お使いのリソースのエンドポイントとキーを確認します。

- Azure portal 内では、これらはお使いのリソースに対して “同じ” エンドポイントと、”異なる” キーとして表示されます。** ** これを確認するには、Azure portal に移動します。 上部の検索バーで Content Safety を検索します。 リソースを見つけて、それをクリックします。 左側のメニューの [リソース管理] で [Keys and Endpoints] を見つけます。** ** [Keys and Endpoints] を選択して、お使いのリソースのエンドポイントとキーを表示します。

作業が終了したら、Azure portal から Content Safety リソースを削除してかまいません。 リソースを削除することは、サブスクリプション内にリソースが存在する場合に生じるコストを削減する 1 つの方法です。 これを行うには、お使いの Content Safety リソースの [概要] ページに移動します。 画面の上部で [削除] を選択します。